网络编程笔记

网络编程笔记

网络编程核心概念与流程详解

Socket 是什么?

Socket(套接字) 是网络通信的 端点,类似于现实中的“电话”。它是操作系统提供的一种 抽象接口,允许程序通过 IP 地址 + 端口号(Port) 与其他设备进行通信。

- 作用:Socket 是网络数据传输的通道,负责 发送数据 和 接收数据。

- 类比:

- 电话:Socket 相当于一部手机,IP 地址相当于电话号码,端口号相当于分机号。

- 邮局:IP 地址是城市地址,端口号是具体收件人的门牌号。

为什么要创建 Socket?

唯一标识通信端点:

- 每个 Socket 绑定一个 IP + 端口,确保数据能准确发送到目标程序。

- 例如:Web 服务器通常绑定

80端口,客户端通过IP:80访问它。

管理通信协议:

- Socket 支持不同的协议(如 TCP 可靠传输、UDP 快速但不可靠)。

操作系统资源管理:

- Socket 是操作系统管理的资源,创建 Socket 相当于向系统申请通信能力。

Socket 的工作流程(以 TCP 为例)

1. 服务端流程

步骤 1:创建 Socket

1 | int server_fd = socket(AF_INET, SOCK_STREAM, 0); |

- 参数说明:

AF_INET:使用 IPv4 协议。SOCK_STREAM:使用 TCP 协议(可靠、面向连接)。

- 作用:创建一个用于监听的 Socket,类似安装一部座机电话。

步骤 2:绑定 IP 和端口(Bind)

1 | struct sockaddr_in address; |

- 作用:将 Socket 绑定到本机的 IP 和端口,相当于给座机电话分配号码。

- 关键点:

INADDR_ANY:服务端可以监听所有网卡(如局域网和公网 IP)。htons(8080):将端口号转换为网络字节序(避免大小端问题)。

步骤 3:监听连接(Listen)

1 | listen(server_fd, 5); // 最大等待连接数为 5 |

- 作用:开始监听客户端的连接请求,类似打开电话的接听功能。

- 参数:

5表示等待队列的最大长度,超过后新连接会被拒绝。

步骤 4:接受连接(Accept)

1 | int client_fd; |

- 作用:接受客户端的连接请求,并为该客户端创建一个 新的 Socket。

- 为什么需要新 Socket?

- 服务端需要同时处理多个客户端,每个客户端独立通信。

- 主 Socket(

server_fd)仅用于监听,新 Socket(client_fd)负责与客户端通信。

步骤 5:收发数据(Read/Write)

1 | char buffer[1024]; |

- 作用:通过新 Socket 与客户端进行数据交换。

2. 客户端流程

步骤 1:创建 Socket

1 | int client_fd = socket(AF_INET, SOCK_STREAM, 0); |

- 与服务端类似,创建用于通信的 Socket。

步骤 2:连接服务端(Connect)

1 | struct sockaddr_in server_addr; |

- 作用:向服务端发起连接请求,类似拨打服务端的电话号码。

- 关键点:客户端需要知道服务端的 IP 和端口。

步骤 3:收发数据(Write/Read)

1 | write(client_fd, "Hello Server", 12); // 发送数据 |

Socket 的底层工作原理

1. TCP 三次握手

当客户端调用 connect() 时,触发 TCP 三次握手:

- 客户端发送

SYN包(同步请求)。 - 服务端回复

SYN-ACK包(确认请求)。 - 客户端回复

ACK包(最终确认),连接建立。

2. 为什么服务端需要多 Socket?

- 主 Socket(监听 Socket):

负责监听新连接,不参与数据传输。 - 新 Socket(客户端 Socket):

每个客户端连接后,服务端为其分配独立的 Socket,实现并发处理。

3. 数据传输流程

- 数据从应用程序写入 Socket 缓冲区。

- 操作系统将数据封装为 TCP 报文,通过网卡发送。

- 接收方的 Socket 缓冲区接收数据,应用程序读取。

完整通信流程示例

服务端代码(伪代码)

1 | // 1. 创建 Socket |

客户端代码(伪代码)

1 | // 1. 创建 Socket |

关键概念总结

| 概念 | 作用 |

|---|---|

| Socket | 网络通信的端点,绑定 IP 和端口,负责数据传输。 |

| Bind | 将 Socket 绑定到本机的 IP 和端口,类似分配电话号码。 |

| Listen | 开启监听模式,等待客户端连接请求。 |

| Accept | 接受客户端连接,创建新 Socket 用于通信。 |

| Connect | 客户端主动连接服务端的 IP 和端口。 |

| Read/Write | 通过 Socket 发送和接收数据。 |

类比理解

服务端:像一个客服中心。

- 安装座机电话(

socket())。 - 设置电话号码(

bind())。 - 开启接听模式(

listen())。 - 接到客户来电后,分配专属客服(

accept())。 - 客服与客户通话(

read()/write())。

- 安装座机电话(

客户端:像打电话的客户。

- 用手机拨号(

socket()+connect())。 - 与客服交流(

write()/read())。

- 用手机拨号(

通过 Socket,程序可以像打电话一样实现跨网络的通信。理解这些步骤后,可以进一步学习多线程、非阻塞 IO 或异步编程,以处理高并发场景。

服务端与客户端的交互流程

服务端创建监听 Socket:

- 作用:专门用于 监听 客户端的连接请求。

- 类比:客服中心的总机号码,只负责接听来电,不处理具体业务。

客户端发起连接:

- 客户端通过

connect()向服务端的监听 Socket(IP + Port)发起连接请求。 - 类比:客户拨打客服总机号码。

- 客户端通过

服务端接受连接并创建会话 Socket:

- 服务端通过

accept()接受连接后,创建新的会话 Socket(如client_fd)与客户端通信。 - 类比:总机将电话转接给专属客服,后续由客服处理客户需求。

- 关键点:

- 监听 Socket(

server_fd)始终存在,持续监听新连接。 - 每个客户端连接都会生成独立的会话 Socket,实现 并发处理。

- 监听 Socket(

- 服务端通过

通过会话 Socket 通信:

- 服务端和客户端通过各自的 Socket(服务端的

client_fd和客户端的client_fd)进行read()/write()。 - 类比:客服和客户通过分机通话。

- 服务端和客户端通过各自的 Socket(服务端的

关键细节补充

1. 为什么需要两个 Socket?

- 监听 Socket:

仅负责接收新连接请求(类似总机),不参与数据传输。若用它直接通信,服务端将无法同时处理其他客户端。 - 会话 Socket:

每个客户端连接后,服务端为其分配独立的 Socket,确保 并发处理(如同时服务 1000 个客户端)。

2. TCP 连接的建立时机

- 客户端调用

connect()时触发 TCP 三次握手。 - 服务端调用

accept()时,从已建立的连接队列中取出一个连接(握手已完成)。- 操作系统内核会维护一个队列,存放已完成握手的连接,

accept()只是从中取出。

- 操作系统内核会维护一个队列,存放已完成握手的连接,

3. 会话 Socket 的端口问题

- 客户端 Socket 的端口由操作系统自动分配(如

12345)。 - 服务端的会话 Socket 复用监听 Socket 的端口(如

8080),但通过四元组(服务端 IP + Port + 客户端 IP + Port)区分不同连接。

完整流程示意图

1 | 服务端 客户端 |

总结

你的理解完全正确,且清晰地把握了服务端和客户端的分工逻辑。实际开发中,服务端会通过 多线程、I/O 多路复用(如 select/epoll)或 异步编程 来高效管理多个会话 Socket,这正是高性能服务器的核心设计之一。

终端节点(Endpoint)的详细解释

在网络编程中,终端节点(Endpoint) 是通信链路中的一个逻辑端点,用于唯一标识网络中参与通信的某一方(客户端或服务端)。它通过 IP 地址 + 端口号(Port) 的组合来精确定位一个进程(或服务),是网络通信中数据收发的基础单元。

终端节点的核心定义

组成要素

终端节点由以下两部分构成:

- IP 地址:标识网络中的一台设备(如

192.168.1.100或fe80::1)。 - 端口号:标识设备上的一个具体进程或服务(如

80表示 HTTP 服务)。

核心作用

- 唯一性:通过

IP:Port的组合,确保数据准确发送到目标进程。 - 协议无关性:终端节点的定义适用于 TCP、UDP、HTTP 等多种协议。

- 端到端通信的基础:两个终端节点(客户端和服务端)通过其

IP:Port建立连接或传输数据。

终端节点在不同协议中的表现形式

TCP/UDP

- 终端节点:

IP地址 + 端口号。 - 示例:

- 服务端:

192.168.1.100:8080 - 客户端:

192.168.1.200:54321

- 服务端:

UNIX 域套接字(本地通信)

- 终端节点:文件系统路径(如

/tmp/my_socket)。 - 用于同一台机器上的进程间通信(IPC)。

HTTP/WebSocket

- 终端节点:URL(如

http://example.com:80/api)。 - 底层仍通过

IP:Port实现,但抽象为更易读的域名和路径。

终端节点的工作机制

客户端如何构造终端节点?

假设客户端需要连接服务端 192.168.1.100:8080,步骤如下:

定义服务端终端节点:

1

2

3

4

5// C++ 示例(使用 Boost.Asio)

boost::asio::ip::tcp:: endpoint endpoint(

boost::asio::ip::address:: from_string("192.168.1.100"), // IP

8080 // Port

);通过终端节点发起连接:

1

2boost::asio::ip::tcp:: socket socket(io_context);

socket.connect(endpoint); // 连接到服务端的终端节点

服务端如何绑定终端节点?

服务端需绑定一个终端节点以监听请求:

1 | // 绑定 0.0.0.0:8080(监听所有网卡的 8080 端口) |

终端节点的关键特性

唯一性

- 同一时刻,一个终端节点只能被一个进程占用(避免端口冲突)。

- 示例:若服务端已绑定

0.0.0.0:8080,其他进程无法再绑定该端口。

动态性

- 客户端端口通常由操作系统自动分配(称为“临时端口”)。

- 服务端端口:固定(如

80)。 - 客户端端口:随机(如

54321)。

- 服务端端口:固定(如

协议关联性

- 终端节点与协议绑定。例如:

TCP 192.168.1.100:8080和UDP 192.168.1.100:8080是两个不同的终端节点。

终端节点的实际应用

客户端代码示例(Python)

1 | import socket |

服务端代码示例(Python)

1 | import socket |

常见问题

为什么需要端口号?

- IP 地址只能定位到设备,端口号进一步定位到设备上的具体进程。

- 类比:IP 地址是公司地址,端口号是部门分机号。

终端节点与 Socket 的关系

- Socket 是操作系统提供的通信接口(类似“电话”)。

- 终端节点 是 Socket 的地址(类似“电话号码”)。

如何避免端口冲突?

- 确保同一终端节点(IP + Port)不被多个进程同时占用。

- 服务端通常绑定固定端口,客户端使用临时端口。

总结

- 终端节点是网络通信的坐标:通过

IP:Port精确定位通信双方。 - 客户端通过终端节点连接服务端:构造目标终端节点并调用

connect()。 - 服务端通过终端节点监听请求:绑定终端节点并调用

listen()/accept()。

理解终端节点是掌握网络编程的基础,后续学习多线程、异步 IO 或协议设计时,均需围绕终端节点展开。

流程实现

以下是使用 C++ 和 Boost.Asio 库 实现的完整网络编程示例,涵盖 服务端 和 客户端 的流程。代码详细注释了每一步的操作,并解释了关键概念。

服务端代码(同步阻塞模型)

1 |

|

客户端代码(同步阻塞模型)

1 |

|

代码详解

服务端关键步骤

创建

io_context:- Boost.Asio 的核心类,负责调度异步操作(本例中为同步操作)。

创建

tcp::acceptor:- 绑定到

tcp::v4()(所有 IPv4 接口)和端口8080,开始监听连接请求。

- 绑定到

接受客户端连接:

acceptor.accept(client_socket)阻塞等待客户端连接。- 连接成功后,

client_socket用于与客户端通信。

读写数据:

read_some读取客户端数据(阻塞直到数据到达)。write发送响应数据。

客户端关键步骤

- 创建

io_context:与服务端一致。 - 连接服务端:

socket.connect()连接到服务端的终端节点(127.0.0.1:8080)。

- 读写数据:

- 用户输入消息后发送给服务端。

read_some接收服务端响应。

编译与运行

1. 安装 Boost 库

- Ubuntu:

sudo apt-get install libboost-all-dev - Windows: 下载 Boost 源码,编译并配置开发环境。

2. 编译命令(Linux)

1 | # 服务端 |

3. 运行

1 | # 启动服务端 |

流程示意图

1 | 服务端 客户端 |

关键概念回顾

| 类/函数 | 作用 |

|---|---|

boost::asio:: io_context |

管理异步操作的核心基础设施(本例中用于同步操作)。 |

tcp::acceptor |

服务端用于监听和接受新连接的组件。 |

tcp::socket |

表示一个网络连接,用于读写数据。 |

tcp::endpoint |

终端节点,由 IP 地址和端口号构成(如 127.0.0.1:8080)。 |

read_some/write |

同步读写数据的函数(阻塞直到操作完成)。 |

扩展:如何处理多个客户端?

上述服务端只能同时处理一个客户端。要支持并发,可以通过以下方式改进:

- 多线程:每个客户端连接后创建一个线程处理。

- 异步模型:使用

async_accept和async_read/async_write实现非阻塞 IO。

多线程服务端示例片段:

1 | // 在 accept 后创建线程处理客户端 |

通过这个示例,你可以清晰地看到 Boost.Asio 如何实现网络通信的核心流程。实际开发中,可根据需求选择同步或异步模型,并结合线程池等技术构建高性能服务器。

Socket 生命周期管理

你的问题触及到网络编程中 Socket 生命周期管理 的核心机制。理解以下分层逻辑后,这个设计会变得非常清晰:

Socket 的阶段性角色

Socket 的工作流程是分阶段的,不同阶段需要不同的信息:

| 阶段 | 所需信息 | 目的 |

|---|---|---|

| 创建阶段 | 协议(TCP/UDP)、I/O 上下文 | 初始化操作系统资源,确定传输协议(TCP 面向连接/UDP 无连接) |

| 绑定阶段 | 本地 IP + Port(服务端需要) | 服务端固定监听地址,客户端通常由系统自动分配 |

| 连接阶段 | 对端 IP + Port(客户端需要) | 客户端主动指定服务端地址 |

| 通信阶段 | 已建立连接的两个端点 | 数据传输 |

为什么创建 Socket 时不需端点信息?

(1) Socket 的抽象性

- Socket 是通信的“句柄”,类似文件描述符(File Descriptor)。

- 创建 Socket 时,操作系统只为通信预留资源,并未绑定具体地址。

- 类比:买一部手机(创建 Socket),但尚未插入 SIM 卡(未绑定 IP/Port)。

(2) 端点信息的动态性

- 服务端:需要先绑定自己的 IP + Port(通过

bind()),再监听连接。 - 客户端:通常不手动绑定 IP + Port(由系统自动分配临时端口),但需通过

connect()指定服务端的 IP + Port。 - 核心逻辑:端点信息是在 不同阶段动态附加到 Socket 的,而非创建时固定。

完整流程示例

服务端代码(附加端点信息的阶段)

1 | // 1. 创建 Socket(无端点信息) |

客户端代码(附加端点信息的阶段)

1 | // 1. 创建 Socket(无端点信息) |

关键机制解释

(1) 客户端端口的自动分配

- 客户端通常不需要手动绑定端口,系统会分配一个临时端口(Ephemeral Port,范围通常为 32768~60999)。

- 通过

socket.local_endpoint()可获取自动分配的本地端点。

(2) 服务端端口的固定性

- 服务端必须绑定固定端口(如

80),以便客户端明确连接目标。 - 若服务端不绑定端口,客户端将无法找到它。

(3) 端点信息的延迟绑定

- 设计优势:允许 Socket 在不同场景下复用(如先绑定再监听,或先创建再连接)。

- 资源优化:避免在未确定用途时占用网络资源。

完整通信流程中的端点信息流

1 | 客户端 Socket 生命周期: |

总结

- Socket 创建:仅初始化通信能力和协议,不涉及具体地址。

- 端点信息动态附加:通过

bind()(服务端)和connect()(客户端)在后续阶段指定。 - 设计哲学:将资源分配与地址绑定解耦,提高灵活性和资源利用率。

这种分层设计允许开发者更灵活地控制 Socket 的行为,例如:

- 同一个 Socket 可先绑定到不同地址测试兼容性。

- 客户端 Socket 可在不同时间连接到不同服务端。

boost::asio::ip::tcp:: acceptor 的详细解析

acceptor 是 Boost.Asio 中服务端监听和接受客户端连接的核心组件。

一、tcp::acceptor 的作用

tcp::acceptor 是服务端专用的类,用于 监听指定端口 并 接受客户端的连接请求。它的工作流程如下:

- 绑定到本地端口(通过

bind())。 - 开始监听(通过

listen())。 - 接受连接(通过

accept()),并为每个客户端创建一个新的tcp::socket用于通信。

二、核心方法详解

1. 构造函数

1 | // 方式1:创建未绑定的 acceptor |

2. bind() - 绑定到本地端点

1 | boost::system:: error_code ec; |

3. listen() - 开始监听

1 | acceptor.listen(boost::asio::socket_base:: max_listen_connections, ec); |

4. accept() - 接受连接

1 | tcp:: socket client_socket(io_context); |

5. async_accept() - 异步接受连接

1 | // 异步接受连接(非阻塞) |

6. 其他方法

| 方法 | 作用 |

|---|---|

local_endpoint() |

获取绑定的本地端点(IP + Port) |

cancel() |

取消所有异步操作 |

set_option() |

设置选项(如 reuse_address) |

三、完整代码示例(同步模型)

服务端代码

1 |

|

四、关键概念详解

1. 地址重用 (reuse_address)

问题:服务端关闭后,端口可能处于

TIME_WAIT状态,导致无法立即重启。解决:通过

set_option(reuse_address(true))允许立即重用端口。代码示例:

1

acceptor.set_option(tcp::acceptor:: reuse_address(true));

2. 同步 vs 异步接受连接

- 同步 (

accept()):阻塞当前线程,直到有客户端连接。 - 异步 (

async_accept()):非阻塞,需配合io_context::run()使用,适合高性能服务器。

3. 处理多个客户端

多线程:每接受一个连接,创建一个新线程处理。

1

2

3

4acceptor.accept(client_socket);

std:: thread([&client_socket] {

// 处理客户端通信

}).detach();异步模型:使用

async_accept链式调用,适合高并发。

五、异步接受连接示例

1 |

|

六、总结

tcp::acceptor的核心作用:服务端监听端口并接受客户端连接。- 关键操作:

bind(),listen(),accept()。 - 设计选择:

- 同步模型简单,适合低频连接。

- 异步模型高效,适合高并发场景。

- 实际应用:结合多线程或异步模型构建高性能服务器。

在 Boost.Asio 中,acceptor 不是普通的 Socket,但它与 Socket 有密切的关联。具体来说:

acceptor 的本质

acceptor是basic_socket_acceptor的实例,而普通 Socket(如tcp::socket)是basic_stream_socket的实例。两者都继承自

basic_socket,但用途不同:类型 作用 直接基类 tcp::acceptor监听和接受连接 basic_socket_acceptortcp::socket数据传输(读写) basic_stream_socket

** 设计逻辑**

- 监听 Socket(

acceptor):

专门用于服务端监听端口并接受连接请求,不参与数据传输。- 示例:客服中心的总机电话(只接听来电,转接分机)。

- 数据 Socket(

tcp::socket):

用于与客户端建立连接后收发数据。- 示例:分机电话(与客户通话)。

代码验证

通过继承关系可以验证二者的差异:

1 | // 检查类型关系 |

tcp::acceptor和tcp::socket均派生自basic_socket,但属于不同的子类。

功能区别

| 功能 | tcp::acceptor |

tcp::socket |

|---|---|---|

| 监听端口 | ✅ 通过 bind() + listen() |

❌ 不支持 |

| 接受连接 | ✅ 通过 accept() |

❌ 不支持 |

| 发送/接收数据 | ❌ 不支持 | ✅ 通过 read()/write() |

| 连接对端 | ❌ 不支持 | ✅ 通过 connect() |

** 代码示例**

服务端使用 acceptor 和 socket:

1 |

|

总结

acceptor是监听专用的 Socket:

继承自basic_socket,但功能仅限于监听和接受连接。- 普通

socket是数据通信的 Socket:

继承自basic_stream_socket,用于连接后的数据传输。 - 二者分工明确:

acceptor负责“接电话”,socket负责“通话”。

线程池:从入门到精通

线程池基础

1. 什么是线程池?

线程池是一种多线程处理技术,预先创建一组线程并管理其生命周期,用于高效执行多个任务。通过复用线程,减少创建和销毁线程的开销,提升系统性能。

2. 为什么需要线程池?

- 减少开销:频繁创建/销毁线程消耗资源。

- 控制并发:避免无限制创建线程导致系统崩溃。

- 提高响应:任务到达时,立即有可用线程处理。

- 统一管理:集中管理线程状态、优先级和资源。

3. 线程池核心组件

- 任务队列:存储待处理的任务(线程安全)。

- 工作线程:执行任务的线程集合。

- 线程管理器:动态调整线程数量,监控状态。

线程池工作原理

1. 任务提交

用户将任务提交到线程池的任务队列中。

2. 任务调度

- 若核心线程未满,创建新线程执行任务。

- 若核心线程已满,任务进入队列等待。

- 若队列满且线程数未达最大值,创建临时线程。

- 若队列满且线程数已达最大值,触发拒绝策略。

3. 线程执行

工作线程从队列中取出任务并执行。

4. 线程回收

- 核心线程常驻,除非池关闭。

- 非核心线程空闲超时后被终止。

线程池关键参数

| 参数 | 描述 |

|---|---|

| 核心线程数 | 线程池保持的最小活动线程数 |

| 最大线程数 | 线程池允许的最大线程数 |

| 任务队列容量 | 队列可存放的最大任务数 |

| 空闲线程存活时间 | 非核心线程空闲多久后被回收 |

| 拒绝策略 | 队列和线程全满时如何处理新任务 |

拒绝策略类型:

- AbortPolicy:抛出异常(默认)。

- DiscardPolicy:静默丢弃新任务。

- DiscardOldestPolicy:丢弃队列中最旧的任务,尝试重新提交。

- CallerRunsPolicy:由提交任务的线程直接执行。

实现一个简单线程池(C++示例)

1 |

|

代码解析:

- 构造函数:创建指定数量的工作线程,每个线程循环等待任务。

- enqueue:将任务添加到队列,并通知一个等待线程。

- 析构函数:设置停止标志,唤醒所有线程并等待其结束。

线程池高级主题

1. 动态调整线程池参数

- 根据系统负载自动调整核心线程数和最大线程数。

- 示例:CPU密集型任务可设线程数 ≈ CPU核心数,IO密集型可设更多线程。

2. 优先级任务队列

- 使用优先队列(如

std::priority_queue)实现任务优先级。 - 高优先级任务先被执行。

3. 任务依赖管理

- 使用

std::future和std::promise处理任务间依赖。 - 示例:任务B依赖任务A的结果,A完成后触发B。

4. 分布式线程池

- 跨机器调度任务,需结合网络通信(如gRPC、消息队列)。

- 示例:将计算密集型任务分发到多台服务器执行。

线程池性能优化

1. 避免过度同步

- 使用无锁队列(如

boost::lockfree:: queue)减少锁竞争。 - 分区锁:将任务队列分片,每个片使用独立锁。

2. 合理配置参数

- CPU 密集型:线程数 ≈ CPU 核心数。

- IO 密集型:线程数可适当增加(如 2 倍核心数)。

- 队列容量根据内存和任务特性调整。

3. 监控与调优

- 监控任务执行时间、队列长度、线程活跃数。

- 使用工具(如 Prometheus+Grafana)可视化指标。

常见问题与解决方案

| 问题 | 原因 | 解决方案 |

|---|---|---|

| 任务堆积 | 生产速度 > 消费速度 | 增大线程数或队列容量,优化任务逻辑 |

| 线程泄漏 | 线程未正确终止 | 确保析构函数正确释放所有线程 |

| 死锁 | 锁顺序不当或任务相互等待 | 统一锁顺序,使用超时锁 |

| 资源竞争 | 多线程访问共享资源未同步 | 使用互斥锁或原子操作 |

实际应用案例

案例 1:Web 服务器请求处理

- 场景:处理大量 HTTP 请求。

- 实现:使用线程池处理每个请求的读取、解析和响应。

- 优化:根据请求类型(静态资源 vs 动态计算)动态调整线程优先级。

案例 2:批量数据处理

- 场景:处理日志文件,统计用户行为。

- 实现:将文件分块,由线程池并行处理每块数据。

- 优化:使用工作窃取(Work Stealing)平衡负载。

最佳实践

- 避免长时间阻塞任务:防止线程长时间占用,影响其他任务。

- 优雅关闭:等待所有任务完成后再终止线程池。

- 异常处理:捕获任务中的异常,避免线程崩溃。

- 资源限制:根据系统资源(CPU、内存)合理配置线程池。

通过以上内容,您可以从基础到高级全面掌握线程池的设计、实现与优化。实际应用中,结合具体场景调整策略,充分发挥线程池的性能优势。

Boost.Asio 缓冲区(boost::asio:: buffer)详解

缓冲区的基本概念

在 Boost.Asio 中,缓冲区(Buffer) 用于表示一块连续的内存区域,用于数据的读取和写入。它是网络通信中数据传递的核心载体,封装了内存地址和大小信息,并提供类型安全的接口。

为什么使用 boost::asio:: buffer?

- 类型安全:支持多种容器类型(如数组、

std::vector、std::string),避免手动计算大小。 - 灵活性:自动推导内存区域的大小和类型,简化代码。

- 兼容性:与 Boost.Asio 的异步操作无缝集成,支持分散-聚集(Scatter-Gather)IO。

缓冲区的创建方式

从原始数组创建

1 | char raw_data[1024]; |

从 std::vector 创建

1 | std:: vector <char> vec_data(1024); |

从 std::string 创建

1 | std:: string str_data = "Hello, Boost.Asio!"; |

从智能指针创建(需管理生命周期)

1 | auto shared_data = std:: make_shared <std::vector<char> >(1024); |

四、缓冲区的类型

| 类型 | 描述 | 典型用途 |

|---|---|---|

mutable_buffer |

可读写的内存区域 | 接收数据(如 async_read) |

const_buffer |

只读的内存区域 | 发送数据(如 async_write) |

缓冲区的使用示例

示例 1:同步写入数据

1 | boost::asio:: io_context io; |

示例 2:异步读取数据

1 | std:: vector <char> receive_buffer(1024); |

缓冲区的生命周期管理

关键规则:

- 同步操作:缓冲区只需在调用期间有效。

- 异步操作:缓冲区必须保持有效,直到操作完成。

安全实践:

使用

std::shared_ptr管理动态分配的缓冲区:1

2

3

4

5auto buffer = std:: make_shared <std::vector<char> >(1024);

socket.async_read_some(

boost::asio:: buffer(*buffer),

[buffer](auto ec, auto size) { /* 操作完成前 buffer 保持有效 */ }

);

分散-聚集 IO(Scatter-Gather)

Boost.Asio 允许同时操作多个缓冲区,适用于协议头和消息体分离的场景。

示例:同时写入头和体

1 | std:: string header = "HEADER"; |

动态缓冲区(dynamic_buffer)

Boost.Asio 提供 dynamic_buffer 适配器,允许缓冲区在需要时自动扩展。

示例:动态读取数据

1 | boost::beast:: flat_buffer dynamic_buf; // 或 boost::asio:: dynamic_buffer(...) |

常见问题与解决方案

| 问题 | 原因 | 解决方案 |

|---|---|---|

| 缓冲区溢出 | 接收数据超出缓冲区大小 | 使用 dynamic_buffer 或动态调整缓冲区 |

| 悬空指针 | 异步操作中缓冲区提前释放 | 使用 shared_ptr 管理缓冲区生命周期 |

| 类型不匹配 | 传递错误的缓冲区类型 | 确保 async_read 用 mutable_buffer,async_write 用 const_buffer |

总结

- 核心作用:

boost::asio:: buffer封装内存区域,简化数据传递。 - 关键类型:

mutable_buffer(读写)和const_buffer(只读)。 - 生命周期:异步操作中需确保缓冲区有效。

- 高级特性:分散-聚集 IO 和动态缓冲区提升灵活性。

通过合理使用缓冲区,可以高效、安全地实现 Boost.Asio 的网络通信功能。

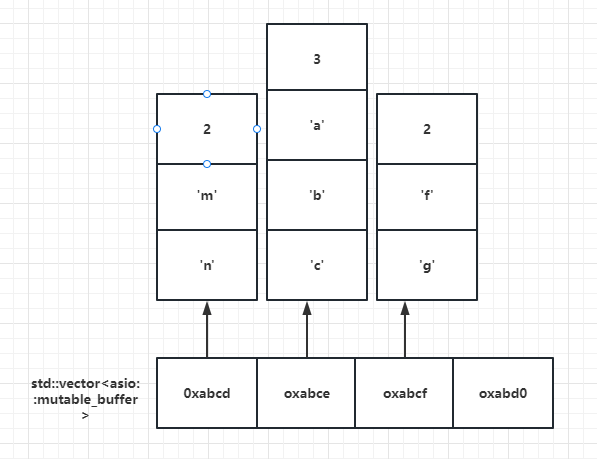

任何网络库都有提供 buffer 的数据结构,所谓 buffer 就是接收和发送数据时缓存数据的结构。

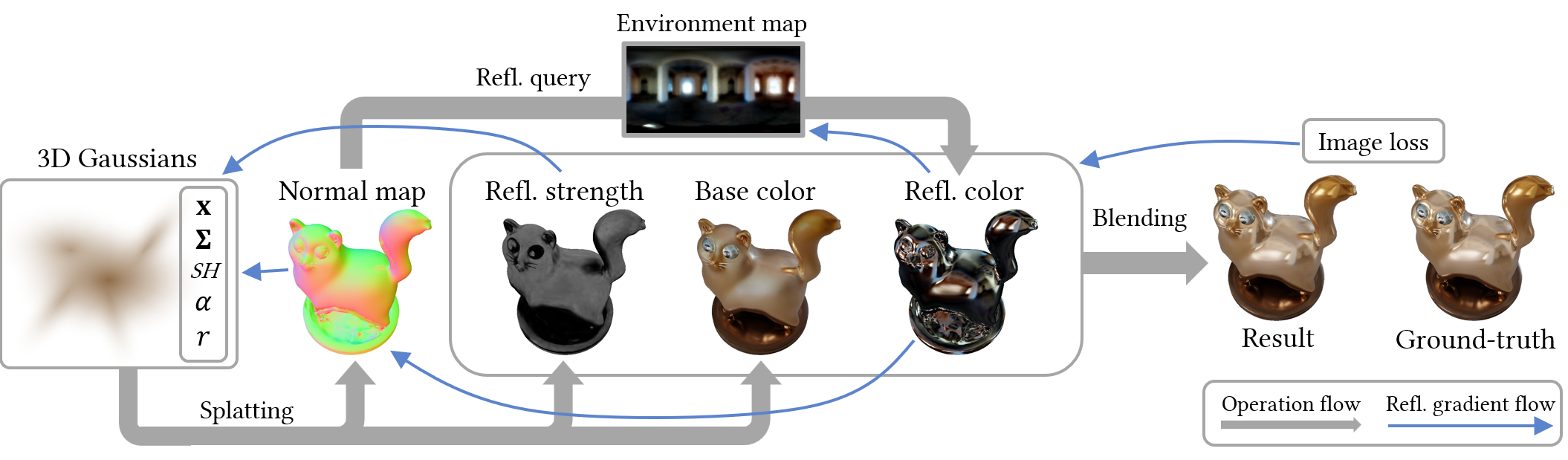

boost:: asio 提供了 asio:: mutable_buffer 和 asio:: const_buffer 这两个结构,他们是一段连续的空间,首字节存储了后续数据的长度。

asio:: mutable_buffer 用于写服务,asio:: const_buffer 用于读服务。但是这两个结构都没有被 asio 的 api 直接使用。

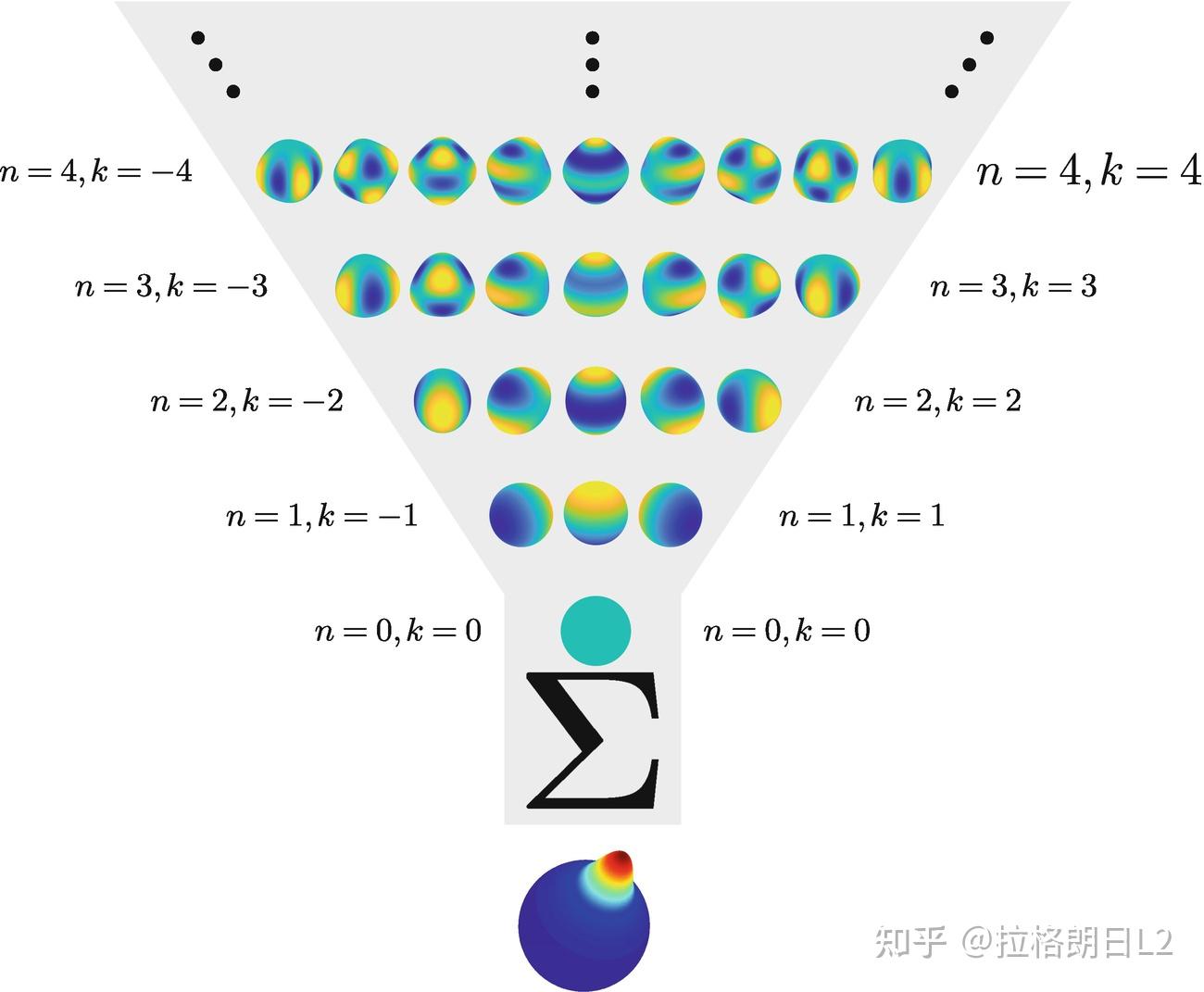

对于 api 的 buffer 参数,asio 提出了 MutableBufferSequence 和 ConstBufferSequence 概念,他们是由多个 asio:: mutable_buffer 和 asio:: const_buffer 组成的。也就是说 boost:: asio 为了节省空间,将一部分连续的空间组合起来,作为参数交给 api 使用。

我们可以理解为 MutableBufferSequence 的数据结构为 std:: vector asio:: mutable_buffer

结构如下

每隔 vector 存储的都是 mutable_buffer 的地址,每个 mutable_buffer 的第一个字节表示数据的长度,后面跟着数据内容。

这么复杂的结构交给用户使用并不合适,所以 asio 提出了 buffer()函数,该函数接收多种形式的字节流,该函数返回 asio:: mutable_buffers_1 o 或者 asio:: const_buffers_1 结构的对象。

如果传递给 buffer()的参数是一个只读类型,则函数返回 asio:: const_buffers_1 类型对象。

如果传递给 buffer()的参数是一个可写类型,则返回 asio:: mutable_buffers_1 类型对象。

asio:: const_buffers_1 和 asio:: mutable_buffers_1 是 asio:: mutable_buffer 和 asio:: const_buffer 的适配器,提供了符合 MutableBufferSequence 和 ConstBufferSequence 概念的接口,所以他们可以作为 boost:: asio 的 api 函数的参数使用。

简单概括一下,我们可以用 buffer()函数生成我们要用的缓存存储数据。

比如 boost 的发送接口 send 要求的参数为 ConstBufferSequence 类型

缓冲序列详解

在 Boost.Asio 中,asio::const_buffers_1 和 asio::mutable_buffers_1 是用于将单个缓冲区(const_buffer 或 mutable_buffer)适配成符合 缓冲区序列(Buffer Sequence) 概念的包装器。它们的核心区别在于 用途 和 类型安全,下面详细解释:

一、基本概念

1. 缓冲区类型

mutable_buffer

表示一块 可修改 的内存区域(如接收数据的缓冲区)。const_buffer

表示一块 只读 的内存区域(如发送数据的缓冲区)。

2. 缓冲区序列(Buffer Sequence)

Boost.Asio 的许多函数(如 async_read、async_write)要求传入的参数满足 缓冲区序列概念(MutableBufferSequence 或 ConstBufferSequence)。

MutableBufferSequence

序列中的每个元素必须是mutable_buffer。ConstBufferSequence

序列中的每个元素必须是const_buffer。

3. 适配器的作用

const_buffers_1

将单个const_buffer包装成一个符合ConstBufferSequence的序列。mutable_buffers_1

将单个mutable_buffer包装成一个符合MutableBufferSequence的序列。

二、核心区别

| 特性 | const_buffers_1 |

mutable_buffers_1 |

|---|---|---|

| 底层类型 | 包装 const_buffer |

包装 mutable_buffer |

| 用途 | 用于 发送数据(如 async_write) |

用于 接收数据(如 async_read) |

| 数据可修改性 | 不可修改(只读) | 可修改(读写) |

| 序列概念 | 符合 ConstBufferSequence |

符合 MutableBufferSequence |

三、为什么需要这些适配器?

Boost.Asio 的函数设计需要支持 分散-聚集 I/O(Scatter-Gather I/O),即同时操作多个缓冲区。例如:

- 发送多个数据块:将多个

const_buffer合并发送。 - 接收数据到多个缓冲区:将数据分散写入多个

mutable_buffer。

问题:如果用户只传递单个缓冲区(如 mutable_buffer 或 const_buffer),如何让这些函数统一处理?

答案:通过 const_buffers_1 和 mutable_buffers_1 将单个缓冲区包装成 单元素序列,使其符合缓冲区序列的接口要求。

四、实际用法示例

1. 发送数据(使用 const_buffers_1)

1 | std::string data = "Hello Server!"; |

2. 接收数据(使用 mutable_buffers_1)

1 | std:: vector <char> recv_buf(1024); |

3. 手动创建适配器

1 | char raw_data [1024]; |

五、底层实现分析

1. const_buffers_1 的定义

1 | class const_buffers_1 { |

- 它是一个单元素序列,迭代器范围是

[&buffer_, &buffer_ + 1)。

2. mutable_buffers_1 的定义

1 | class mutable_buffers_1 { |

- 结构与

const_buffers_1类似,但包装的是mutable_buffer。

六、自动类型转换

当直接传递 mutable_buffer 或 const_buffer 给需要缓冲区序列的函数时,Boost.Asio 会自动将它们包装成 mutable_buffers_1 或 const_buffers_1。例如:

1 | std:: string data = "Hello"; |

七、总结

| 场景 | 使用的类型 | 目的 |

|---|---|---|

发送数据(async_write) |

const_buffers_1 或 const_buffer |

保证数据只读,符合 ConstBufferSequence |

接收数据(async_read) |

mutable_buffers_1 或 mutable_buffer |

允许修改数据,符合 MutableBufferSequence |

- 核心区别:数据可修改性和对应的序列概念。

- 实际开发中:通常直接使用

boost::asio:: buffer()自动生成适配器,无需手动构造const_buffers_1或mutable_buffers_1。

通过理解这些适配器的作用,可以更安全、高效地使用 Boost.Asio 进行网络编程。

socket.write_some 详解

socket.write_some 详解

boost::asio::ip::tcp::socket:: write_some 是 Boost.Asio 中用于 同步发送数据 的成员函数。它的核心特点是 尝试发送数据,但可能只发送部分内容,具体取决于底层操作系统的网络缓冲区状态。以下是其详细解析:

一、函数定义

1 | size_t write_some(const ConstBufferSequence& buffers); |

- 参数:

buffers:符合ConstBufferSequence概念的数据缓冲区(如boost::asio:: buffer("Hello"))。ec(可选):用于接收错误码,避免抛出异常。

- 返回值:实际发送的字节数(可能小于缓冲区大小)。

- 异常:如果未使用

error_code参数,出错时抛出boost::system:: system_error。

二、核心特性

- 同步操作:阻塞当前线程直到数据开始发送(不保证全部发送)。

- 部分发送:可能只发送部分数据,需手动处理剩余部分。

- 底层直接调用:对应操作系统的

send()函数(Windows)或write()函数(Linux)。

三、使用场景

- 精细控制:需要手动管理每次发送的数据量。

- 非阻塞模式:结合

non_blocking()设置,实现非阻塞发送。 - 低延迟场景:避免等待全部数据发送完成,优先启动传输。

四、与 boost::asio:: write 的区别

| 特性 | socket.write_some |

boost::asio:: write |

|---|---|---|

| 数据完整性 | 可能只发送部分数据,需循环调用 | 内部自动循环,直到所有数据发送完毕 |

| 易用性 | 需要手动处理部分发送 | 直接保证全部发送 |

| 适用场景 | 需要精细控制发送过程 | 常规数据发送(推荐默认使用) |

五、代码示例

示例 1:基本用法(需处理部分发送)

1 |

|

示例 2:错误处理

1 | boost::system:: error_code ec; |

六、关键注意事项

部分发送处理:

必须循环调用

write_some直到所有数据发送完毕。示例:

1

2

3

4

5while (bytes_sent < total_size) {

size_t len = socket.write_some(/* ... */);

if (len == 0) break; // 发送失败或连接关闭

bytes_sent += len;

}

阻塞行为:

- 在 阻塞模式(默认)下,

write_some会等待至少发送一个字节。 - 在 非阻塞模式 下(通过

socket.non_blocking(true)设置),立即返回boost::asio::error:: would_block错误(需配合异步操作或轮询)。

- 在 阻塞模式(默认)下,

缓冲区生命周期:

- 确保在发送过程中,缓冲区内存始终有效(如避免局部变量被销毁)。

七、底层机制

1. 操作系统对应函数

- Linux:调用

write()或send()。 - Windows:调用

send()。

2. 发送流程

- 步骤 1:数据从用户缓冲区复制到内核发送缓冲区。

- 步骤 2:内核通过网络栈发送数据。

- 限制:内核缓冲区剩余空间决定本次能发送的最大字节数。

八、性能与最佳实践

避免频繁小数据发送:

- 合并多次小数据为单次发送,减少系统调用开销。

- 示例:使用

std::vector或boost::asio:: streambuf缓存数据。

错误处理优先级:

- 检查

boost::asio::error:: connection_reset或broken_pipe,及时关闭连接。

- 检查

非阻塞模式配合:

1

2

3

4

5

6socket.non_blocking(true);

boost::system:: error_code ec;

size_t len = socket.write_some(boost::asio:: buffer(data), ec);

if (ec == boost::asio::error:: would_block) {

// 使用异步操作或等待可写事件

}

九、总结

- 核心用途:手动控制数据发送过程,适用于需要部分发送或非阻塞场景。

- 必须处理:循环发送、错误检查、缓冲区生命周期。

- 推荐替代:多数场景优先使用

boost::asio:: write简化逻辑。

通过合理使用 write_some,可以在特定需求下实现高效、可控的网络数据传输。

在 Boost.Asio 中,read/write 和 read_some/write_some 的行为差异与其设计哲学密切相关。以下是针对 Boost.Asio 的详细解释,包含用法和注意事项:

一、read_some vs read

basic_stream_socket::read_some

用途

底层非阻塞/部分读取操作,尝试从 socket 读取 至少 1 字节,但不会保证填满整个缓冲区。行为

- 在 阻塞模式 下,会阻塞直到至少读取 1 字节。

- 在 非阻塞模式 下,若无可读数据,立即返回

boost::asio::error:: would_block错误。 - 返回实际读取的字节数(可能小于缓冲区大小)。

示例代码

1

2

3

4

5

6

7

8

9

10

11

12boost::asio::ip::tcp:: socket socket(io_context);

char buffer [1024];

boost::system:: error_code ec;

size_t bytes_read = socket.read_some(boost::asio:: buffer(buffer), ec);

if (ec == boost::asio::error:: would_block) {

// 非阻塞模式下无数据可读

} else if (ec) {

// 处理其他错误

} else {

// 处理读取的 bytes_read 字节数据

}注意事项

- 需手动处理部分读取(可能需要循环调用)。

- 非阻塞模式下需结合

io_context和异步操作(如async_read_some)实现高效事件驱动。

boost::asio:: read 自由函数

用途

高级封装操作,确保读取 完整指定字节数 或直到发生错误。行为

- 内部循环调用

read_some,直到缓冲区被填满。 - 在阻塞模式下会一直等待;非阻塞模式下需确保 socket 设置为阻塞或通过

async_read使用异步模式。

- 内部循环调用

示例代码

1

2

3

4

5

6

7

8

9

10boost::asio::ip::tcp:: socket socket(io_context);

char buffer [1024];

boost::system:: error_code ec;

size_t bytes_read = boost::asio:: read(socket, boost::asio:: buffer(buffer), ec);

if (ec) {

// 处理错误(如连接关闭)

} else {

// 缓冲区已被完整填充

}注意事项

- 若 socket 在非阻塞模式且数据未就绪,可能直接返回错误。

- 适合需要简化逻辑的场景(如文件传输)。

二、write_some vs write

1. basic_stream_socket::write_some

用途

底层非阻塞/部分写入操作,尝试发送 尽可能多 的数据,但不保证发送全部字节。行为

- 在阻塞模式下,会阻塞直到至少发送 1 字节。

- 在非阻塞模式下,若内核发送缓冲区已满,返回

boost::asio::error:: would_block。 - 返回实际发送的字节数(可能小于请求的大小)。

示例代码

1

2

3

4

5

6

7

8

9

10

11

12const char* data = "Hello, World!";

size_t total_bytes = strlen(data);

boost::system:: error_code ec;

size_t bytes_sent = socket.write_some(boost::asio:: buffer(data, total_bytes), ec);

if (ec == boost::asio::error:: would_block) {

// 非阻塞模式下发送缓冲区已满

} else if (ec) {

// 处理其他错误

} else {

// 继续发送剩余数据(total_bytes - bytes_sent)

}注意事项

- 需手动处理部分写入(可能需要循环或异步续传)。

- 结合非阻塞模式时,通常使用

async_write_some实现高效发送。

2. boost::asio:: write 自由函数

用途

高级封装操作,确保 所有数据发送完毕 或发生错误。行为

- 内部循环调用

write_some,直到所有数据发送完成。 - 在阻塞模式下会一直等待;非阻塞模式下需确保 socket 设置为阻塞或使用异步操作。

- 内部循环调用

示例代码

1

2

3

4

5

6

7

8

9

10const char* data = "Hello, World!";

size_t total_bytes = strlen(data);

boost::system:: error_code ec;

size_t bytes_sent = boost::asio:: write(socket, boost::asio:: buffer(data, total_bytes), ec);

if (ec) {

// 处理错误(如连接中断)

} else {

// 所有数据已发送

}注意事项

- 非阻塞模式下可能无法直接使用(需通过异步接口)。

- 适合需要原子性写入的场景(如协议头+体的完整发送)。

三、关键区别总结

| 特性 | read_some/write_some (成员函数) |

read/write (自由函数) |

|---|---|---|

| 数据完整性 | 可能部分传输 | 确保完整传输 |

| 底层控制 | 需手动循环处理剩余数据 | 自动处理循环 |

| 适用模式 | 非阻塞 I/O、自定义事件循环 | 阻塞模式、简化逻辑 |

| 错误处理 | 可能返回 would_block |

直接返回最终错误或成功 |

| 性能优化 | 适合精细控制(如结合 io_context 轮询) |

适合简单场景 |

四、注意事项

1. 阻塞 vs 非阻塞模式

阻塞模式:

read_some/write_some会阻塞直到至少操作 1 字节。read/write会阻塞直到完成所有操作。

非阻塞模式:

read_some/write_some可能立即返回would_block,需结合异步操作。read/write在非阻塞模式下可能直接失败,除非数据已就绪。

2. 异步操作

- 使用

async_read_some和async_write_some时,需通过回调处理部分数据。 async_read和async_write会自动处理循环,直到完成完整传输。

3. 缓冲区管理

- 确保缓冲区生命周期在异步操作中有效(如使用

std::shared_ptr或boost::asio:: buffer的拷贝)。

五、代码实践示例

使用 read_some 手动循环读取

1 | char buffer[1024]; |

使用 async_read 简化异步读取

1 | char buffer [1024]; |

六、总结

选择

read_some/write_some:

需要精细控制非阻塞 I/O 或实现自定义协议(如分片处理)。选择

read/write:

需要简化代码逻辑或确保数据完整性(如文件传输、固定头协议)。

通过理解 Boost.Asio 的设计哲学,可以更高效地利用其同步/异步接口实现高性能网络应用。

async_write_some

在 Boost.Asio 中,async_write_some 是一个用于异步发送数据的底层成员函数,它允许非阻塞地发送尽可能多的数据,但不保证一次性发送全部内容。以下是对 async_write_some 的详细解释,包括其用法、行为、注意事项及与 async_write 的对比。

一、async_write_some 基本用法

函数签名

1 | template <typename ConstBufferSequence, typename WriteHandler> |

参数说明

buffers

要发送的数据缓冲区,通常通过boost::asio:: buffer包装(如boost::asio:: buffer(data, size))。handler

异步操作完成后的回调函数,其签名为:1

2

3

4void handler(

const boost::system:: error_code& ec, // 错误码

std:: size_t bytes_transferred // 实际发送的字节数

);

示例代码

1 |

|

二、async_write_some 的行为

1. 非阻塞操作

async_write_some是异步的,调用后立即返回,不会阻塞当前线程。- 实际的数据发送由操作系统在后台完成。

2. 部分发送

- 可能只发送部分数据(例如,发送缓冲区满时)。

- 回调函数的

bytes_transferred表示实际发送的字节数,需手动处理剩余数据。

3. 错误处理

- 如果发送过程中出现错误(如连接断开),

ec参数会指示具体错误类型。 - 常见错误:

boost::asio::error:: operation_aborted(操作被取消)、boost::asio::error:: connection_reset(连接重置)。

三、注意事项

1. 数据缓冲区的生命周期

- 异步操作未完成时,必须确保缓冲区内存有效。

- 如果数据是临时变量,需将其拷贝到长期存储(如

std::shared_ptr)或在回调中管理生命周期。

2. 处理部分发送

- 需在回调中检查

bytes_transferred,并继续发送剩余数据(递归或循环调用async_write_some)。

3. 线程安全性

- 回调函数可能在任意线程中执行,需确保线程安全(如使用

strand或锁)。

4. 错误传播

- 若发生错误,需终止发送或重试,避免无限循环。

四、async_write_some vs async_write

| 特性 | async_write_some (成员函数) |

async_write (自由函数) |

|---|---|---|

| 数据完整性 | 可能部分发送,需手动处理剩余数据 | 确保全部数据发送完毕 |

| 控制粒度 | 底层操作,适合精细控制 | 高层封装,简化逻辑 |

| 适用场景 | 自定义协议、分片发送 | 需要原子性发送完整数据的场景 |

| 缓冲区管理 | 需手动维护剩余数据 | 自动处理多次发送 |

| 错误处理 | 需手动处理每次发送的错误 | 统一处理最终错误 |

五、完整示例:分片发送数据

1 |

|

六、常见问题

1. 如何处理非阻塞模式下的 would_block?

async_write_some不会直接返回would_block,因为它是异步的。- 如果底层发送缓冲区已满,操作系统会排队数据,回调函数会在可写时触发。

2. 如何取消异步操作?

- 调用

socket.cancel()取消所有未完成的异步操作,回调函数会收到operation_aborted错误。

3. 如何优化性能?

- 合并小数据包,减少系统调用次数。

- 使用

boost::asio:: buffer的聚集写(scatter-gather)功能发送多个缓冲区。

七、总结

使用

async_write_some:

需要手动控制异步发送过程,适合实现自定义协议或分片逻辑(如大文件分块传输)。

需注意缓冲区生命周期、部分发送处理和错误传播。使用

async_write:

更简单安全,适合需要原子性发送完整数据的场景(如发送固定长度的协议头)。

通过合理选择二者,可以在灵活性和开发效率之间取得平衡。

async_read_some 是如何工作的

代码解析

1 | this->_socket->async_read_some( |

async_read_some函数的作用async_read_some是 Asio 库中用于异步读取数据的函数。它尝试从套接字中读取数据,并将读取的数据存储到指定的缓冲区中。它的原型大致如下:

1

2template <typename MutableBufferSequence, typename ReadHandler>

void async_read_some(const MutableBufferSequence& buffers, ReadHandler handler);buffers:表示要存储读取数据的缓冲区。handler:是一个回调函数,当读取操作完成时会被调用。

缓冲区参数

boost::asio:: buffer(send_data->_msg + send_data->_current_length, send_data->_total_length - send_data->_current_length)- 这里使用

boost::asio:: buffer创建了一个缓冲区,指定了从send_data->_msg的_current_length位置开始,长度为_total_length - _current_length的内存区域。 - 这意味着从

send_data->_msg的当前未读取部分开始,尝试读取剩余的数据。

- 这里使用

回调函数

std:: bind(&Session:: WriteCallback, this, std::placeholders::_1, std::placeholders::_2)- 这里使用

std::bind创建了一个可调用对象,用于作为async_read_some的回调函数。 &Session::WriteCallback是Session类中的一个成员函数,表示当异步读取操作完成时要调用的回调函数。this是当前对象的指针,表示WriteCallback函数将作为当前对象的成员函数被调用。std::placeholders::_1和std::placeholders::_2是占位符,分别表示async_read_some完成时传递给回调函数的两个参数:_1:通常是表示操作是否成功的boost::system:: error_code。_2:通常是表示实际读取的字节数。

- 这里使用

std::bind 的返回值作为回调函数

std::bind 返回的是一个可调用对象,这个对象可以像普通函数一样被调用。在 Asio 的异步操作中,回调函数可以是一个普通函数、一个绑定的成员函数,或者是一个可调用对象(如 std::bind 的返回值)。

当 async_read_some 完成时,Asio 会调用回调函数,并将操作结果作为参数传递给回调函数。在这个例子中,std::bind 返回的可调用对象会被调用,它会将 WriteCallback 成员函数绑定到当前对象,并将 Asio 传递的参数(error_code 和实际读取的字节数)传递给 WriteCallback。

示例

假设 Session 类的定义如下:

1 | class Session { |

当 async_read_some 完成时,Asio 会调用 std::bind 返回的可调用对象,它会调用 Session::WriteCallback,并将 error_code 和 bytes_transferred 作为参数传递给它。

总结

std::bind返回的可调用对象可以直接作为回调函数传递给async_read_some。- 这种方式允许你将成员函数作为回调函数使用,同时将当前对象的上下文(

this)绑定到回调函数中。 - Asio 会调用这个可调用对象,并将操作结果传递给它,最终调用

WriteCallback成员函数。

async_send 的详细解析

async_send 是 Boost.Asio 库中用于异步发送数据的函数。它通常用于 TCP 套接字,用于将数据发送到连接的对端。以下是 async_send 的详细解析和使用方法:

async_send 函数原型

1 | template <typename ConstBufferSequence, typename WriteHandler> |

buffers:表示要发送的数据缓冲区。可以是一个或多个缓冲区,通常使用boost::asio:: buffer来创建。handler:当发送操作完成时被调用的回调函数。回调函数的签名必须为:1

void handler(const boost::system:: error_code& error, std:: size_t bytes_transferred);

error:表示操作是否成功。如果为boost::system:: error_code(),则表示操作成功。bytes_transferred:表示实际发送的字节数。

特点

async_send内部会循环调用async_write_some,直到所有数据都被发送完毕。- 回调函数只在发送完成或发生错误时触发。

- 该函数是非阻塞的,调用后会立即返回。

使用场景

- 当需要简化发送逻辑时,

async_send是一个很好的选择。 - 适用于需要确保所有数据都发送完毕的场景。

示例代码

以下是一个使用 async_send 的示例代码:

1 |

|

在这个示例中:

WriteAllToSocket方法将数据添加到发送队列中,并启动异步发送操作。WriteAllCallBack是回调函数,用于处理发送完成后的逻辑。- 使用

async_send确保所有数据都被发送完毕。

注意事项

- 确保在回调函数中正确处理错误情况。

- 如果需要发送多个数据块,可以使用队列管理待发送数据。

- 在发送操作完成之前,不要释放或修改缓冲区。

希望这些信息对你理解 async_send 有所帮助!

处理粘包

1 | void CSession:: HandleRead(const boost::system:: error_code& error, size_t bytes_transferred, std:: shared_ptr <CSession> shared_self){ |

boost::asio协程实现

协程不是操作系统的底层特性,系统感知不到它的存在。它运行在线程里面,通过分时复用线程的方式运行,不会增加线程的数量。协程也有上下文切换,但是不会切换到内核态去,比线程切换的开销要小很多。每个协程的体积比线程要小得多,一个线程可以容纳数量相当可观的协程。在IO密集型的任务中有着大量的阻塞等待过程,协程采用协作式调度,在IO阻塞的时候让出CPU,当IO就绪后再主动占用CPU,牺牲任务执行的公平性换取吞吐量。事物都有两面性,协程也存在几个弊端:线程可以在多核CPU上并行,无法将一个线程的多个协程分摊到多核上。协程执行中不能有阻塞操作,否则整个线程被阻塞。协程的控制权由用户态决定,可能执行恶意的代码。

无论是线程还是协程,都只是操作系统层面的抽象概念,本质是函数执行的载体。可以简单的认为协程是一个能够被暂停以及被恢复运行的函数,在协作调度器的控制下执行,同一个时刻只能运行一个函数。

函数状态的维护完全依赖于线程栈,线程栈中分类连续地址保存函数的运行状态,函数是线程相关的。

如果函数是协程,调用函数的时候,保存函数状态(代码位置,局部变量,函数参数)所需要的内存会提前在堆上分配,独立于线程栈。而调用同时会从堆中读取函数运行状态并复制到线程栈的连续空间中。如果函数需要暂停,当前运行状态会被记录到堆的内存中。当下次协程再次运行时,再次从堆区读取上次所保存的函数运行状态到线程栈。协程与线程无关,因为两次调用协程可能是不同的线程,但是同一个协程。所以协程可以暂停和继续执行。

协程会主动让出控制权,而线程是争抢控制权。

协程定义

定义一个函数,只要出现了co_await,co_yield,co_return中的任意一个,就是定义了一个协程。协程的返回值必须是一个coroutine_interface对象。

协程关键字

下面把 C++20 协程里最常用的 3 个关键字(还有 2 个配套类型)用“一句话解释 + 最小可编译示例”的方式梳理出来。看完就能直接写 demo。

- co_await —— “先挂起,等好了再回来继续”

• 让协程异步等待某个结果,而不会阻塞线程。

• 只要表达式实现了 awaitable 三接口(await_ready / await_suspend / await_resume)就能放在 co_await 后面。

最小示例:自己做一个“睡眠 1 秒后返回 42”的 awaitable。

1 |

|

运行结果:

Start → 1 秒停顿 → co_await 得到: 42。

- co_yield —— “产生一个值,然后挂起”

• 常用于生成器(generator),每次 yield 把值送出去,调用者resume()后继续循环。

最小示例:一个范围生成器。

1 |

|

- co_return —— “协程的最终返回”

• 与return类似,但只能在协程里用。

• 把结果交给 promise_type,然后协程进入 final_suspend。

最小示例:返回字符串。

1 |

|

- 两个极简 awaitable 工具:

std::suspend_always{}—— 总是挂起(最常用占位符)。std::suspend_never{}—— 从不挂起,直接继续执行。

一句话速记

co_await等异步结果co_yield产一个值co_return给最终结果

把这三板斧 + promise_type 拼起来,就能写出 异步任务、生成器、Lazy 值 等各种 C++20 协程应用。

co_spawn和awaitable

一句话先回答

co_spawn:把协程“扔”到某个执行器(io_context / 线程池)里跑awaitable<>:Boost.Asio 协程的“返回类型”,告诉编译器这是一个能co_await的异步协程

下面分开说,再给最小可编译例子。

- co_spawn —— 启动器 / 调度器

作用

- 负责把 用户写的协程函数 绑定到 执行器(

io_context,thread_pool,strand…) - 还能指定启动令牌(

detached、use_awaitable、bind_executor…) - 类似线程池的

std::async,但专为协程优化。

原型(简化)

1 | template <typename Executor, typename Coro, typename Token> |

常用 3 种 Token

boost::asio:: detached

启动后“自生自灭”,不返回句柄,也不抛异常。boost::asio:: use_awaitable

启动后返回awaitable<T>,外层协程可以co_await它。boost::asio:: bind_executor

把协程绑定到某个 strand / 指定执行器。

- awaitable

—— 返回类型

作用

- Boost.Asio 自带的 协程返回对象,内部实现了 C++20 promise_type。

- 只能出现在 协程函数 的返回类型:

awaitable<void>/awaitable<size_t>/awaitable<std::string>… - 任何返回

awaitable<>的函数都 必须 在内部用co_await/co_return/co_yield。

- 最小完整例子(Boost.Asio + C++20)

1 |

|

执行流程

co_spawn创建协程帧 → 绑定到io→ 立即调度。- 协程里

co_await timer.async_wait(...)→ 挂起 1 秒。 - 计时器到时 → 协程恢复 → 打印 →

co_return→ 协程结束。

一句话速记

co_spawn= “调度器,把协程送进事件循环”。awaitable<T>= “Boost.Asio 的协程返回类型,声明这个函数是协程”。

Boost.Asio 网络编程概念详解

您提出了几个关于 Boost.Asio 网络编程的核心概念问题,让我逐一详细解释。

1. Endpoint 的角色:服务端 vs 客户端

您理解得完全正确:

服务端 Endpoint

作用:指定服务器要监听的地址和端口

示例:

1

2

3

4

5// 监听所有 IPv4 地址的 8080 端口

tcp:: endpoint endpoint(tcp:: v4(), 8080);

// 或者监听特定 IP 地址

tcp:: endpoint endpoint(boost::asio::ip::address:: from_string("192.168.1.100"), 8080);

客户端 Endpoint

作用:指定要连接的服务器的地址和端口

示例:

1

2

3

4

5// 连接至特定服务器的 8080 端口

tcp:: endpoint endpoint(

boost::asio::ip::address:: from_string("192.168.1.100"),

8080

);

总结:Endpoint 在服务端表示”我要在这里监听”,在客户端表示”我要连接到哪里”。

2. Socket 的使用:独立还是共享

在 Boost.Asio 中,每个连接都有自己独立的 socket:

服务端 Socket 使用模式

- 监听 Socket (Acceptor):只有一个,用于接受新连接

- 连接 Socket:每个客户端连接都有一个独立的 socket

1 | // 服务端代码示例 |

客户端 Socket 使用模式

1 | // 客户端代码示例 |

重要原则:

- 不要在不同的连接间共享 socket

- 每个 TCP 连接对应一个独立的 socket 对象

- socket 不是线程安全的,不应在多个线程中同时访问同一个 socket

3. IO Context 的使用模式

IO Context 是 Boost.Asio 的核心,有多种使用模式:

模式一:单 IO Context(最简单)

- 整个应用程序使用一个

io_context - 适合简单应用或低并发场景

1 | boost::asio:: io_context io_context; |

模式二:多线程共享一个 IO Context(常见模式)

- 一个

io_context被多个线程共享 - 适合中等并发场景

1 | boost::asio:: io_context io_context; |

模式三:IO Context 池(高性能模式)

- 多个

io_context实例组成池 - 每个

io_context在单独线程中运行 - 适合高并发场景

1 | // IO Context 池 |

模式四:专用 IO Context(高级模式)

- 为特定类型的操作分配专用的

io_context - 例如:一个用于接受连接,一个用于数据处理

1 | // 专用 io_context 用于接受连接 |

总结

Endpoint:

- 服务端:设置自己的监听地址

- 客户端:设置要连接的服务端地址

Socket:

- 每个 TCP 连接有自己独立的 socket

- 不要在不同连接间共享 socket

IO Context:

- 单 IO Context:简单应用

- 多线程共享一个 IO Context:常见模式,中等并发

- IO Context 池:高性能,高并发场景

- 专用 IO Context:高级用法,为不同操作类型优化

选择哪种模式取决于您的应用需求:

- 低并发、简单应用:单 IO Context

- 中等并发:多线程共享一个 IO Context

- 高并发、高性能:IO Context 池

- 特殊需求:专用 IO Context

理解这些概念对于构建高效、可扩展的网络应用程序至关重要。

Boost.Asio 异步操作深度解析

您提出了一个非常核心的问题,这涉及到 Boost.Asio 库的工作原理和操作系统底层机制。让我详细解释异步操作的整个执行过程。

异步操作的整体流程

Boost.Asio 的异步操作遵循一个清晰的流程,可以用以下图示表示:

1 | 应用程序线程 Boost.Asio 操作系统 硬件 |

详细分解执行过程

1. 发起异步操作 (async_read, async_write, async_accept)

当您调用异步操作时:

1 | async_read(socket, buffer, [](error_code ec, size_t bytes) { |

发生的过程:

请求封装:Asio 将您的请求封装成一个操作对象,包含:

- 操作类型(读、写、接受)

- socket 描述符

- 缓冲区信息

- 完成处理程序(您的 lambda 函数)

排队操作:这个操作对象被放入 Asio 的内部队列中

立即返回:函数调用立即返回,不会阻塞当前线程

2. 操作系统层面的处理

Linux (使用 epoll)

1 | // 简化的内部过程 |

具体过程:

- 注册事件监听:Asio 通过

epoll_ctl()告诉内核:”当这个 socket 有数据可读时通知我” - 等待事件:Asio 调用

epoll_wait()阻塞等待事件发生 - 事件发生:当数据到达 socket 时,内核唤醒

epoll_wait() - 事件处理:Asio 获取事件信息并找到对应的操作对象

Windows (使用 IOCP)

在 Windows 上,Asio 使用 I/O Completion Ports:

1 | // 创建完成端口 |

3. 完成处理与回调执行

当操作系统通知事件就绪时:

- 取出操作对象:Asio 从内部队列中找到对应的操作对象

- 执行后续处理:读取数据、处理错误等

- 准备回调:准备调用完成处理程序所需的参数

- 分派回调:将回调任务放入 io_context 的执行队列

1 | // 简化的内部逻辑 |

4. IO Context 的角色

io_context 是整个过程的核心协调者:

1 | boost::asio:: io_context io_context; |

实际代码示例

让我们通过一个具体的例子来看整个流程:

1 |

|

执行顺序:

async_read()被调用,立即返回- 程序继续执行,打印消息

io_context.run()开始处理事件循环- 当数据到达时,操作系统通知 Asio

- Asio 读取数据并调用您的 lambda 回调

为什么这种设计强大?

- 可扩展性:单线程可以处理数千个并发连接

- 资源高效:避免了为每个连接创建线程的开销

- 响应性:不会因为 I/O 操作而阻塞主线程

- 平台抽象:统一接口,底层使用最高效的 OS 机制

底层机制对比

| 平台 | 机制 | 特点 |

|---|---|---|

| Linux | epoll | 水平触发,高效处理大量连接 |

| Windows | IOCP | 完成端口,真正的异步I/O |

| macOS/BSD | kqueue | 类似epoll的高效事件通知 |

| 其他 | select/poll | 作为回退机制,效率较低 |

总结

Boost.Asio 的异步操作是一个精心设计的多层系统:

- 应用层:您调用

async_xxx并提供回调 - Asio层:封装操作、管理队列、与OS交互

- OS层:使用最高效的机制(epoll/IOCP/kqueue)监听事件

- 回调层:事件就绪时,通过

io_context执行您的回调

这种设计使得您可以用同步的编程思维编写异步的高性能代码,而无需直接处理复杂的底层操作系统API。

理解这个过程有助于您编写更高效的网络代码,并更好地调试异步应用程序。

Boost.Asio 异步读取机制深度解析

您提出了几个非常关键的问题,这些正是理解异步I/O编程的核心。让我逐一详细解释。

1. async_read() 调用后立即返回什么?

当您调用 async_read() 时:

1 | async_read(socket, buffer, [](error_code ec, size_t bytes) { |

立即返回的是”操作的初始化状态”,而不是读取的结果。具体来说:

- 函数立即返回:

async_read()调用不会阻塞,它会立即将控制权返回给调用者 - 返回类型:在Boost.Asio中,大多数异步函数返回

void(无返回值) - 操作未完成:实际的读取操作还没有开始,只是”请求”已经被提交

关键理解:async_read() 的调用完成不代表读取操作完成,它只是表示”我已请求在将来某个时间读取数据”

2. 异步函数执行完了吗?触发回调函数了吗?

- 异步函数本身已执行完毕:

async_read()这个函数调用已经完成 - 但异步操作尚未完成:实际的数据读取操作还在等待中

- 回调函数尚未触发:回调函数只有在数据真正可用时才会被调用

可以把 async_read() 想象成”下单订购商品”:

- 您下了订单(调用

async_read()) - 商店确认收到订单(函数返回)

- 但商品还没有送达(数据尚未读取)

- 当商品送达时,才会通知您(回调函数被调用)

3. 读事件如何从阻塞变为就绪再执行?

这是最核心的部分,涉及操作系统级别的I/O多路复用机制。整个过程可以分为几个阶段:

阶段一:注册兴趣(Registering Interest)

当您调用 async_read() 时,Boost.Asio 内部会:

- 创建一个操作对象,包含您的回调函数和其他相关信息

- 告诉操作系统:”当这个socket有数据可读时,请通知我”

- 具体实现取决于操作系统:

- Linux:使用

epoll_ctl()将socket添加到epoll实例中 - Windows:使用

WSARecv()发起重叠I/O操作 - macOS/BSD:使用

kqueue()注册事件

- Linux:使用

阶段二:等待事件(Waiting for Events)

在 io_context.run() 或类似调用中,Boost.Asio 会:

调用操作系统的多路复用函数等待事件:

- Linux:

epoll_wait() - Windows:

GetQueuedCompletionStatus() - macOS/BSD:

kevent()

- Linux:

这些函数会阻塞,直到至少一个注册的事件发生

1 | // 简化的内部逻辑 |

阶段三:事件就绪(Event Becomes Ready)

当数据到达网络缓冲区时:

- 网络接口卡收到数据包

- 操作系统内核处理数据包,将其放入对应socket的接收缓冲区

- 操作系统标记socket为”可读”

- 多路复用函数(如

epoll_wait())检测到状态变化并返回

阶段四:执行回调(Executing the Callback)

当多路复用函数返回后,Boost.Asio:

- 确定哪些socket有就绪的事件

- 找到对应的操作对象

- 执行实际的读取操作(从socket缓冲区复制数据到用户缓冲区)

- 将回调函数放入执行队列

- 最终调用您的回调函数

完整流程示例

让我们通过一个时间线来理解整个过程:

1 | 时间 | 操作 |

为什么需要这种复杂机制?

这种异步模型的主要优势是:

- 高并发:单线程可以处理数千个连接

- 资源高效:避免了线程创建和上下文切换的开销

- 响应性:不会因为I/O操作而阻塞主线程

代码示例与解释

1 |

|

总结

async_read()立即返回:表示异步读取请求已提交,但操作未完成- 回调函数尚未触发:只有在数据真正可用时才会调用

- 从阻塞到就绪的过程:

- 注册对读事件的兴趣

- 等待操作系统通知数据可用

- 数据到达时,操作系统唤醒等待的线程

- 执行实际读取操作并调用回调

这种机制使得单个线程可以高效地管理大量并发连接,是现代高性能网络编程的基石。理解这个过程对于编写高效的异步网络应用程序至关重要。

TCP 是面向字节流的:深入解析

这是一个非常好的问题,触及了TCP协议最核心的特征之一。简单来说,“TCP是面向字节流的” 这句话描述了TCP协议处理数据的方式:它不关心应用层消息的边界,只关心字节的正确性和顺序。

让我用一个生动的比喻和详细的技术解释来帮您彻底理解这个概念。

核心比喻:水管送水

想象一下TCP连接就像一根水管:

- 发送端:你从一端倒入一瓢瓢的水(应用层消息)

- 接收端:从另一端接水,但你接到的可能不是完整的一瓢瓢水,而是连续的水流

- TCP保证:水的总量正确、水的顺序正确、没有杂质

- TCP不保证:你每次接到的正好是完整的一瓢水

与UDP的对比:数据报 vs 字节流

| 特性 | TCP (面向字节流) | UDP (面向数据报) |

|---|---|---|

| 数据视图 | 无边界的数据流 | 有边界的独立数据包 |

| 传输单位 | 字节序列 | 完整的消息(数据报) |

| 消息边界 | 不维护 | 严格维护 |

| 可靠性 | 可靠,保证顺序 | 不可靠,可能乱序 |

| 类比 | 水管送水 | 邮局寄信 |

技术层面的详细解释

1. 发送端的视角

当应用程序调用发送函数时:

1 | // 应用程序发送三条消息 |

在TCP层面,这些数据可能被组合、拆分后发送:

- 可能一次发送:

HelloWorld!(11字节) - 可能分多次发送:

Hel+loWorld+! - TCP只保证所有字节最终都能按顺序到达

2. 接收端的视角

接收端看到的是连续的字节流,不知道原始的消息边界:

1 | char buffer [1024]; |

3. TCP的内部工作机制

TCP使用序列号来跟踪每个字节的位置:

1 | 发送端序列号: HelloWorld! |

TCP维护的是字节的序列,而不是消息的边界。

为什么这样设计?优点是什么?

1. 灵活性

应用程序可以自由决定如何组织数据,不受网络传输限制。

2. 效率优化

- Nagle算法:将多个小数据包组合成一个大包发送,减少网络开销

- 流量控制:根据网络状况动态调整发送速率

- 拥塞控制:避免网络过载,提高整体效率

3. 可靠性保证

通过序列号和确认机制,确保每个字节都正确到达。

带来的挑战:粘包/拆包问题

正因为TCP不维护消息边界,应用程序需要自己处理消息重组的问题:

常见解决方案:

长度前缀法(最常用):

1

2

3

4

5

6

7

8

9

10

11// 发送端:先发送 4 字节长度,再发送数据

uint32_t length = htonl(data.size());

send(socket, &length, 4, 0);

send(socket, data.data(), data.size(), 0);

// 接收端:先读 4 字节长度,再读取相应长度的数据

uint32_t length;

recv(socket, &length, 4, 0);

length = ntohl(length);

std:: vector <char> buffer(length);

recv(socket, buffer.data(), length, 0);分隔符法:

1

2

3// 在每个消息末尾添加特殊分隔符,如 "\r\n"

std:: string message = "Hello\r\n";

send(socket, message.data(), message.size(), 0);固定长度法:

1

2

3// 所有消息都是固定长度,不足部分填充

char message [128] = "Hello";

send(socket, message, 128, 0);

实际编程中的体现

在Boost.Asio或类似网络库中,您会直接体验到这种字节流特性:

1 | // 发送多次,但可能一次接收 |

总结

TCP是面向字节流的意味着:

- 数据无边界:TCP将数据视为连续的字节序列,不维护应用层消息边界

- 可靠性在字节层面:保证每个字节的正确性和顺序,但不保证消息完整性

- 需要应用层处理消息边界:应用程序必须自己实现消息分割和重组机制

- 灵活高效:这种设计提供了更大的灵活性和网络效率优化空间

理解这个概念对于编写正确的网络应用程序至关重要,因为它解释了为什么我们需要在应用层处理消息边界,而不是依赖TCP来自动完成这个任务。

json解析错误

这个 JSON 输出中的 null 出现在 JSON 对象之前,这通常是因为在序列化 JSON 对象之前,您的代码中有一个未初始化的或空的 JSON 值被序列化了。在您的代码中,问题可能出现在以下几个方面:

可能的原因和解决方案

在设置 JSON 字段之前序列化了空的

root对象:

在您的代码中,有一个地方在用户密码匹配后立即序列化了root对象,而此时root可能还没有设置任何字段(即为 null):1

2

3

4//用户邮箱密码匹配

std:: cout << " user pwd match" << std:: endl;

jsonstr = root.toStyledString(); // 这里序列化了空的/未设置的 root

beast:: ostream(connection->_response.body()) << jsonstr;这行代码在设置任何字段之前就序列化了

root,所以会输出null。然后您继续处理,设置了更多字段并再次序列化,导致输出中既有null又有完整的 JSON 对象。解决方案:删除这行不必要的序列化代码。

多次序列化并写入响应体:

您的代码中有多个地方序列化root并写入响应体。如果某个分支执行后没有立即返回,可能会继续执行后续代码,导致多次写入。解决方案:确保每个分支在执行完毕后都立即返回,避免重复写入。

修改后的代码

以下是修改后的代码,解决了上述问题:

1 | RegPost("/post_login", [](std::shared_ptr<HttpConnection> connection) { |

关键修改

删除了在用户密码匹配后立即序列化

root的代码:1

2

3// 删除了这两行:

// jsonstr = root.toStyledString();

// beast:: ostream(connection->_response.body()) << jsonstr;确保每个分支在执行完毕后都立即返回,避免重复写入响应体。

其他可能的原因

如果上述修改后问题仍然存在,请检查:

是否有其他代码在处理相同的请求:确保没有其他处理程序也在处理

/post_login请求并写入响应体。响应体是否被多次写入:检查是否有其他地方调用了

beast::ostream(connection->_response.body())。JSON 序列化问题:确保

root对象在序列化前已正确初始化并设置了所有必要的字段。

通过以上修改,您应该能够消除 JSON 输出中的 null,只输出完整的 JSON 对象。

好的,这是一个非常实际且重要的问题。我们来详细拆解一下TCP和UDP的区别,并看看在Boost.Asio代码上如何体现。

一、TCP vs UDP 核心区别

| 特性 | TCP (传输控制协议) | UDP (用户数据报协议) |

|---|---|---|

| 连接 | 面向连接的 (Connection-oriented)。通信前必须通过三次握手建立稳定连接。 | 无连接的 (Connectionless)。直接发送数据,无需建立连接。 |

| 可靠性 | 可靠的 (Reliable)。通过确认、重传、校验和等机制确保数据不丢失、不重复、按序到达。 | 不可靠的 (Unreliable)。发送即忘,不保证送达,不保证顺序。 |

| 数据传输 | 字节流 (Byte Stream)。没有消息边界。你写入10字节+20字节,对方可能一次收到30字节。 | 数据报 (Datagram)。有消息边界。你发送一个数据报(包),对方就会作为一个完整的消息接收。 |

| 拥塞控制 | 有。会动态调整发送速率以避免网络过载,更公平。 | 无。尽可能快地发送数据,容易造成网络拥堵。 |

| 速度/开销 | 慢,开销大。因为要维护连接、保证可靠性和顺序。 | 快,开销小。几乎没有额外控制开销。 |

| 头部大小 | 较大 (通常20字节以上) | 较小 (仅8字节) |

| 通信模型 | 只能是一对一 (单播) | 支持单播、多播、广播 |

简单比喻:TCP and UDP

- TCP 像打电话:需要先拨号接通(建立连接),双方确认对方在听,你说一句对方回复一句(确认),确保信息准确传达。

- UDP 像发邮政明信片:你写好地址内容就扔进邮筒(发送),不确认对方是否收到,明信片也可能丢失或乱序到达。

二、代码实现上的区别 (基于 Boost.Asio)

你平时用boost::asio::ip::tcp::socket,而UDP则使用boost::asio::ip::udp::socket。这是最根本的区别。以下是关键差异点:

1. 无需连接管理 (Connectionless)

UDP没有connect(), accept(), listen()这些概念(虽然Boost.Asio提供了connect()函数用于过滤发送源,但并非建立连接)。

- TCP服务端典型流程:

acceptor.accept(socket)-> 得到一个与客户端连接的socket。 - UDP服务端典型流程:创建一个socket并绑定到端点

(ip, port),然后直接在这个socket上receive_from和send_to任何客户端。

2. 使用 send_to / receive_from 而非 send / receive

因为无连接,每次发送都必须指定目标地址,每次接收也都能得到发送方的地址。

TCP 使用:

1

2

3boost::asio::write(socket, boost::asio::buffer(data)); // 发送

boost::asio::read(socket, boost::asio::buffer(data)); // 接收

// 或者 socket.async_read_some / async_write_someUDP 使用:

1

2

3

4

5

6

7

8// 发送:需要指定目标端点 (endpoint)

socket.send_to(boost::asio::buffer(data), receiver_endpoint);

// 接收:需要一个变量来存储“是谁发来的”

udp::endpoint remote_endpoint; // 用来存放发送方的地址

socket.receive_from(boost::asio::buffer(recv_buf), remote_endpoint);

// 异步版本类似

socket.async_receive_from(boost::asio::buffer(recv_buf), remote_endpoint, handler);

3. 消息边界 (Message Boundary)

这是处理数据时最大的不同。

- TCP:你需要自己定义协议来划分消息边界(例如:在每个消息前加一个消息头,指明消息体的长度)。

- UDP:一次

receive_from调用对应对方的一次send_to调用。你收到的就是一个完整的包。无需担心粘包问题。

三、代码示例:UDP Echo Server vs TCP Echo Server

让我们看一个最简单的Echo服务器对比。

TCP Echo Server (片段 - 异步接受后)

1 | // ... 有 acceptor.accept 过程 ... |

UDP Echo Server (完整示例)

1 |

|

四、何时使用UDP?

既然UDP不可靠,为什么还要用它?在特定场景下,速度比可靠性更重要。

- 音视频流媒体/实时游戏:丢失一两个帧(数据包)远比赛道卡顿(等待重传)要好。例如:视频通话、在线游戏的角色位置。

- DNS查询:查询请求很小,无连接开销低,如果没收到回复,客户端重试一次即可。

- 广播/多播:例如网络发现协议(“谁是这个网段里的打印机?”)。

- ** VoIP**:和音视频类似。

- 自定义可靠协议:在UDP之上实现自己需要的可靠性机制(例如:KCP、QUIC/HTTP3)。这可以让你摆脱TCP的拥塞控制算法,为你的特定应用优化传输效率。

总结

| 代码层面 | TCP | UDP |

|---|---|---|

| Socket类型 | boost::asio::ip::tcp::socket |

boost::asio::ip::udp::socket |

| 建立连接 | 需要 acceptor, accept(), connect() |

无需,直接 bind() 即可 |

| 发送函数 | async_write, send |

async_send_to, send_to |

| 接收函数 | async_read_some, receive |

async_receive_from, receive_from |

| 数据边界 | 无,是流,需自定义协议 | 有,数据报天然有边界 |

| 端点管理 | 每个连接一个socket,端点固定 | 一个socket与多个端点通信,需变量存储临时端点 |

如果你想从TCP切换到UDP,最关键的就是改变无连接和数据报的思维模式,并在代码中熟练使用send_to/receive_from和endpoint。